OpenAI GPT-4.1が新しいデフォルトモデルとしてGitHub Copilotで一般提供開始 – GitHubブログ

2025-05-09

Choosing the right AI model for your task – GitHub Docs

o3 まとめ

思考時間: 1m 27s

概要 — 何が起きたのか

2025年5月9日、GitHub は OpenAI GPT-4.1 を Copilot Chat/Edits/Agent Mode の 新しいデフォルトモデル(GA) として展開開始しました。これまで標準だった GPT-4o はモデルピッカーには残るものの、90 日以内に非推奨 となる予定です 。

1. GPT-4.1 の技術的ハイライト

| 指標 | GPT-4.1 | GPT-4o (従来) |

|---|---|---|

| 知識カットオフ | 2024年6月 | 2023年10月 |

| 最大コンテキスト | 最大100万トークン¹ | 128 k |

| マルチモーダル | 画像入力(Vision)プレビュー対応 | 同左 |

| 処理速度 | GPT-4oと同等の低レイテンシ | 低レイテンシ |

| 主な改良点 | コーディング精度↑、構造化応答の安定、フォーマット順守、長文把握 | – |

¹API 版の上限。IDE からの利用ではツール側 UI が制限する場合があります。

性能ベンチマーク

OpenAI と第三者ベンチの合算値では コーディング系ベンチで GPT-4o 比 21 % 向上、GPT-4.5 比 27 % 向上 と報告されています 。

2. なぜ GitHub はデフォルトを更新したのか

- 実運用最適化

GPT-4.1 はフロントエンド開発やコード整形で「余計な編集を減らす」よう学習し直されており、チャットでも決めたフォーマットを崩しにくい 。 - 長文理解

大規模モノレポや API 仕様書の貼り付けなど、IDE での「長いペースト」を以前より安全に処理できる。 - コスト効率

OpenAI は GPT-4.1 を GPT-4.5 より 低コストで提供。Copilot 側でもプレミアムモデルの利用枠を抑えやすい 。

3. ユーザーへの影響

| 項目 | 影響 | 補足 |

|---|---|---|

| 既存設定 | 自動で GPT-4.1 に切替 | IDE が v1.100 以降なら即日/Cloud は順次ロールアウト |

| GPT-4o 利用 | モデルピッカーで選択可だが 90 日で非推奨 | プロジェクト依存で再現性を維持したい場合に推奨 |

| 画像入力 | Vision API は 引き続きプレビュー | 「Alt + I」入力などは同じ |

| IP 補償 | GA モデル扱い になり、生成コードに GitHub の IP 補償が適用 | 企業導入で重要なポイント |

| プレミアムリクエスト | GPT-4.1 の倍率は未公表(推定 10-15×)。6 月4 日から正式課金 | 限度施行が 5 月7 日→6 月4 日に延期 (github.blog) |

4. 乗り換え/切り替えの実務チェックリスト

- IDE 拡張を最新化

- VS Code 1.100 以降/JetBrains 2025.1 + Copilot 1.48 以上で自動受信。

- モデルピッカーで確認

- 「GPT-4.1」が Base と表示されていれば新デフォルト。

- CI / GPT スクリプトで API バージョン固定

model=gpt-4oを明示していたスクリプトは再評価。

- 長文入力のテスト

- 1 ファイル >30 k トークンの貼り付け挙動を確認。

- コスト監視ダッシュボードを有効に

- 5 月下旬から IDE 上に使用量カウンターが出現 (github.blog)。

5. 今後の展望と注意点

| 期限 | 予定 | 影響 |

|---|---|---|

| 2025-06-04 | プレミアムリクエスト上限の正式施行 | GPT-4.1 利用で上限に到達しやすくなる可能性 |

| 2025-08-上旬 | GPT-4o 非推奨化 | 固定運用のリポジトリはモデル再調整が必要 |

| 2025-07 | GPT-4.5 Preview API 終了 (OpenAI 発表) | 自前エージェントで GPT-4.5 を呼び出している場合は移行必須 |

6. エンジニア視点の評価ポイント

- ラージコンテキストが VS Code エディターでどこまで活きるか

- 実際には拡張機能側の安全ガードが 200 k 前後で頭打ちという報告もあり、今後の UI 改善に期待。

- IP 補償が GA モデル限定である点

- Vision プレビューで生成したコード片は補償対象外になる可能性があるため、商用利用時は区別が必要。

- プレミアム枠消費と ROI

- GPT-4.1 は GPT-4o に対して正確さ・冗長編集削減が向上しているため、「少ない再生成で済む」= 結果的にコスト減 となるケースも多い。

- 将来の GPT-4.1-mini/nano 統合

- ゲートウェイレイテンシのさらなる低減が見込まれ、コーディングアシストの 「即応性」 が強化される流れ。

参考リンク(GitHub Docs 内)

📝 まとめ

GPT-4.1 は 「速度は維持しつつ精度を底上げ」 したバージョンアップであり、デフォルト変更は妥当と言えます。特に 長文/多ファイル を扱う地方中小企業のレガシーコード改修において、少ないプロンプト回数で確実に要件を満たす提案が得られる点は大きなメリットです。プレミアム枠の制御さえ把握していれば、開発効率とコストのバランスは好転する可能性が高いでしょう。

翻訳作業の確認

ユーザーは、英語の記事「Choosing the right AI model for your task – GitHub Docs」の翻訳を依頼しています。提供されたのは英語の抜粋なので、その内容を日本語に翻訳する必要があります。記事が長い場合、セクションや表も含まれている可能性があり、これらも正確に翻訳することが重要です。全体記事を翻訳しなくても良いはずですが、抜粋の正確な翻訳に気をつけます。

思考時間: 25 秒

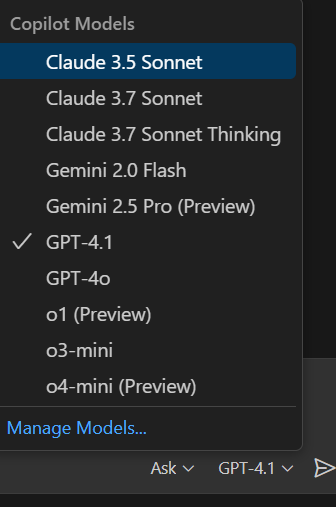

Copilot Chat で利用できる AI モデルを比較し、タスクに最適なモデルを選択しましょう。

GitHub Copilot 用 AI モデルの比較

GitHub Copilot では、性能の異なる複数の AI モデルを利用できます。選択したモデルによって、Copilot Chat の回答やコード補完の品質・関連性が変わります。レイテンシが低いモデルもあれば、ハルシネーションが少ないモデルや特定のタスクで優れた性能を発揮するモデルもあります。

この記事では、利用可能なモデルを比較し、それぞれの長所を理解して、タスクに最適なモデルを選択するのに役立つ情報を提供します。実際のタスクを用いたモデル比較のガイドについては、「異なるタスクを使った AI モデルの比較」 を参照してください。

最適なモデルはユースケースによって異なります。

- コストと性能のバランスを重視する場合: GPT-4.1 または Claude 3.7 Sonnet

- 高速・低コストで基本的なタスクをこなしたい場合: o4-mini または Claude 3.5 Sonnet

- 深い推論や複雑なコーディング課題には: o3, GPT-4.5, Claude 3.7 Sonnet

- マルチモーダル入力やリアルタイム性能には: Gemini 2.0 Flash または GPT-4.1

以下のモデル名をクリックすると、それぞれの詳細な概要とユースケースにジャンプできます。

- GPT-4.1

- GPT-4o

- GPT-4.5

- o1

- o3

- o3-mini

- o4-mini

- Claude 3.5 Sonnet

- Claude 3.7 Sonnet

- Gemini 2.0 Flash

- Gemini 2.5 Pro

注

モデルごとに「プレミアムリクエスト係数」が異なり、月間使用量の消費に影響します。詳しくは 「プレミアムリクエストについて」 を参照してください。

GPT-4.1

OpenAI の最新モデル GPT-4.1 が GitHub Copilot と GitHub Models で利用可能になりました。GPT-4o を全面的に上回り、コーディング、指示追従、長文コンテキスト理解で大幅に向上しています。コンテキストウィンドウが拡大し、知識カットオフも 2024 年 6 月 に更新されています。

開発者からのフィードバックを基に、フロントエンドコーディング、余分な編集の削減、フォーマット順守、応答構造の一貫性、ツール使用の安定性など、実運用向けに最適化されています。速度・応答性・汎用的な推論が求められる一般的な開発タスクのデフォルトとして最適です。

ユースケース

GPT-4.1 は GPT-4o を改良したモデルで、幅広い知識、迅速な反復、基本的なコード理解を必要とするタスクで大きく向上しています。

長所

以下の表に GPT-4.1 の長所をまとめています。

代替オプション

| タスク | 説明 | 別モデルが適する理由 |

|---|---|---|

| マルチステップの推論やアルゴリズム | 複雑なロジック設計や多段階問題の分解 | GPT-4.5 または Claude 3.7 Sonnet の方が段階的思考が得意 |

| 複雑なリファクタリング | 大規模コードベースのリファクタリングや複数ファイルの連動更新 | GPT-4.5 はコンテキストと依存関係をより堅牢に扱える |

| システムレビューやアーキテクチャ検討 | 構造・パターン・アーキテクチャ判断の詳細分析 | Claude 3.7 Sonnet または GPT-4.5 がより深い分析を提供 |

GPT-4o

GPT-4o はテキストと画像を扱うマルチモーダルモデルで、リアルタイム応答が可能です。軽量な開発タスクや Copilot Chat の会話型プロンプトに適しています。

従来モデルと比べ、マルチリンガル性能が向上し、視覚コンテンツの解釈能力も強化。GPT-4 Turbo 相当の性能を、低レイテンシ・低コストで提供するため、多くの一般的な開発タスクに良いデフォルト選択となります。

詳細は OpenAI のドキュメント を参照してください。

ユースケース

速度・応答性・汎用的な推論が求められる一般的開発タスクに適しています。

長所

以下の表に GPT-4o の長所をまとめています。

代替オプション

下表に、別モデルが適するシナリオを示します。

GPT-4.5

GPT-4.5 は推論力・信頼性・文脈理解が向上したモデルで、複雑なロジックや高品質コード生成、微妙な意図解釈を伴う開発タスクに向きます。

GPT-4.1 と比べ、多段階推論や長文コンテンツ、複雑な問題解決でより一貫した結果を生成しますが、レイテンシとコストはやや高めです。

詳細は OpenAI のドキュメント を参照してください。

ユースケース

多段階工程、深いコード理解、ニュアンスを扱う会話型モデルが必要なタスクに適します。

長所

以下の表に GPT-4.5 の長所をまとめています。

代替オプション

下表に、別モデルが適するシナリオを示します。

o1

o1 は OpenAI の旧世代の推論モデルで、複雑な多段階タスクや深い論理推論をサポートします。

詳細は OpenAI のドキュメント を参照してください。

ユースケース

深い論理推論を要するタスクに適しており、デバッグで特に効果を発揮します。問題の背景まで踏み込み、暗黙のエッジケースや根本原因を特定できます。

長所

以下の表に o1 の長所をまとめています。

代替オプション

下表に、別モデルが適するシナリオを示します。

o3

注

o3 は Copilot Chat で現在パブリックプレビュー中で、仕様が変更される可能性があります。

o3 は o シリーズで最も高性能な推論モデルで、深いコーディングワークフローや複雑な多段階タスクに理想的です。詳細は OpenAI のドキュメント を参照してください。

ユースケース

デバッグや複雑な論理推論を要するタスクに適しており、問題を明確で実行可能なステップに分解できます。

長所

以下の表に o3 の長所をまとめています。

代替オプション

下表に、別モデルが適するシナリオを示します。

o3-mini

o3-mini は高速かつコスト効率に優れた推論モデルで、o1 を上回るコーディング性能を、o1-mini と同等の応答速度で提供します。Copilot では OpenAI の「medium」推論設定を使用しています。

詳細は OpenAI のドキュメント を参照してください。

ユースケース

シンプルまたは反復的なコーディング質問に高速・確実な回答が必要な開発者に適しています。

長所

以下の表に o3-mini の長所をまとめています。

代替オプション

下表に、別モデルが適するシナリオを示します。

o4-mini

注

o4-mini は Copilot Chat で現在パブリックプレビュー中で、仕様が変更される可能性があります。

o4-mini は o シリーズで最も効率的なモデルで、低レイテンシ・低リソースながらコーディング性能を提供します。

詳細は OpenAI のドキュメント を参照してください。

ユースケース

シンプルまたは反復的なコーディング質問に高速で信頼性の高い回答を得たい開発者に向いています。

長所

以下の表に o4-mini の長所をまとめています。

代替オプション

下表に、別モデルが適するシナリオを示します。

Claude 3.5 Sonnet

Claude 3.5 Sonnet は日常的な開発タスク向けに設計された高速かつコスト効率の高いモデルです。深い推論は Claude 3.7 Sonnet ほど得意ではありませんが、ドキュメント作成やボイラープレート生成など、迅速な応答を要するコーディングタスクに適しています。

詳細は Anthropic のドキュメント および Copilot での Claude 利用方法 を参照してください。

ユースケース

ドキュメント執筆、言語固有の質問への回答、ボイラープレートコード生成などの日常的コーディング支援に適しています。コスト制約がある場合でも有力な選択肢です。

長所

以下の表に Claude 3.5 Sonnet の長所をまとめています。

代替オプション

下表に、別モデルが適するシナリオを示します。

Claude 3.7 Sonnet

Claude 3.7 Sonnet は Anthropic の最先端モデルで、大規模・複雑なコードベースに対する構造化推論に優れています。高速応答と段階的な深掘り分析を両立します。

詳細は Anthropic のドキュメント および Copilot での Claude 利用方法 を参照してください。

ユースケース

設計初期からバグ修正・最適化までソフトウェア開発ライフサイクル全般で活躍します。複数ファイルのリファクタリングやアーキテクチャ設計にも適しています。

長所

以下の表に Claude 3.7 Sonnet の長所をまとめています。

代替オプション

下表に、別モデルが適するシナリオを示します。

Gemini 2.0 Flash

Gemini 2.0 Flash は Google の高速マルチモーダルモデルで、リアルタイム応答と視覚入力を伴うタスクに最適化されています。

詳細は Google のドキュメント および Copilot での Gemini 利用方法 を参照してください。

ユースケース

UI のスクリーンショット解析やレイアウトデバッグなど、画像入力が問題解決を助けるシナリオに有効です。

長所

以下の表に Gemini 2.0 Flash の長所をまとめています。

代替オプション

下表に、別モデルが適するシナリオを示します。

Gemini 2.5 Pro

Gemini 2.5 Pro は Google の最新モデルで、高度な推論とコーディング機能を備え、長い文脈を必要とする重いリサーチワークフローにも適しています。

詳細は Google のドキュメント および Copilot での Gemini 利用方法 を参照してください。

ユースケース

複雑なアルゴリズム開発や大規模コードベースのデバッグ、学術研究のデータ解析など、強力なモデルが求められる場面に適します。

長所

以下の表に Gemini 2.5 Pro の長所をまとめています。

代替オプション

下表に、別モデルが適するシナリオを示します。

コメントを残す